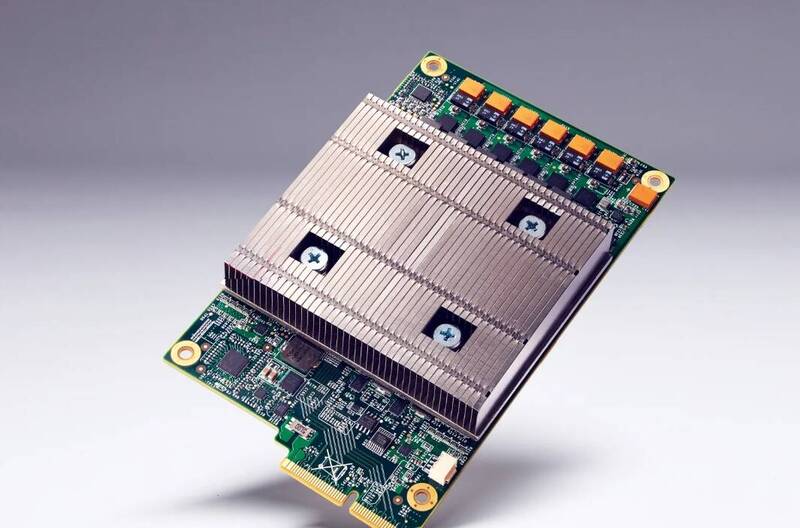

輝達以GPU稱霸AI運算近十年,如今迎來了強勁挑戰者,即Google自行打造的TPU。(圖/Google提供)

輝達以GPU稱霸AI運算近十年,如今迎來了強勁挑戰者,即Google自行打造的TPU。(圖/Google提供)

Meta將使用Google的TPU晶片

〔財經頻道/綜合報導〕《The Information》於11月25日報導,一位知情人士透露,Meta正在與Google洽談,計劃於2027年在其資料中心使用Google自研的客製化晶片,即張量處理單元(TPU),也稱張量處理器。該報導還稱,Meta明年也可能向Google Cloud租用相關晶片。

若交易成真,TPU將成為輝達(NVIDIA)GPU(圖形處理器)的可行替代方案,進一步擴大Google在AI晶片市場的影響力。消息一出,輝達股價一度下滑2.7%,而Google母公司Alphabet股價最高上漲2.7%。

報導指出,Google先前就已與AI新創公司Anthropic達成協議,提供最多100萬顆TPU。Seaport分析師Jay Goldberg稱,這是對TPU的「強力背書」,也讓更多科技企業開始認真評估輝達以外的選項。如果這回達成協議,將表明Google晶片的發展趨勢強勁,並具有挑戰輝達市場主導地位的長期潛力。

與Meta達成協議,對Google來說無疑是一次勝利。但關鍵在於,這些TPU晶片能否展現出足夠的能源效率和運算能力,成為長期可行的解決方案。

近十年來,AI的大爆發重塑全球科技產業的秩序。從自動駕駛、虛擬助手到大型語言模型,背後推動這一切的,不只是演算法的進步,更是「運算能力」的突破。然而,當外界將焦點都放在模型大小與能力提升時,真正決定科技版圖的,是那一顆顆深藏於資料中心、看似不起眼的運算晶片。

輝達以GPU稱霸AI運算近十年,然而,這個看似不可撼動的地位,如今迎來了最強挑戰者,即Google自行打造的TPU。這種為深度學習量身訂做的專用AI晶片,正大幅提高訓練、推論的效率,並以高速、低功耗與大規模擴展能力,悄悄改寫全球AI基礎建設的權力平衡。

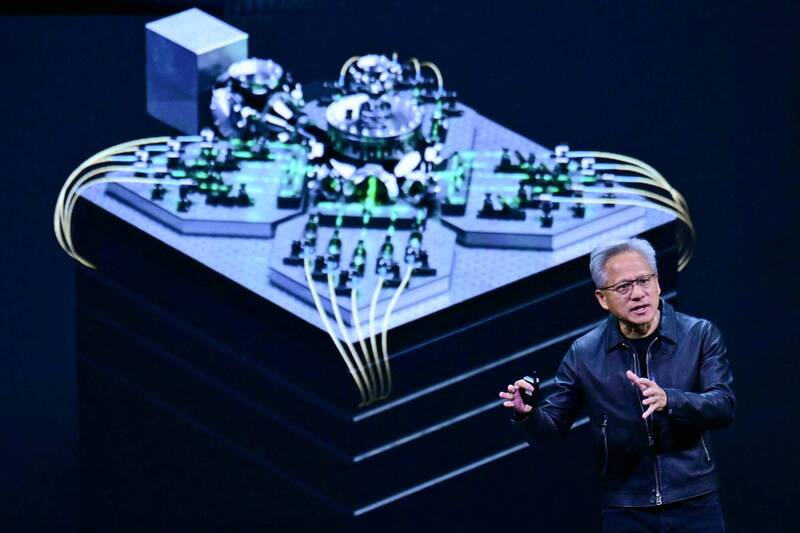

Meta正與Google洽談採購TPU晶片事宜。(資料照,路透)

Meta正與Google洽談採購TPU晶片事宜。(資料照,路透)

TPU具客製化 高能率特點

若將AI的興起比喻成工業革命,輝達GPU就像是最先被大量投入工廠的蒸汽機。GPU本來只是為遊戲與繪圖所設計的硬體,其大量平行運算核心原本是為處理像素、光影等圖形工作。但當深度學習迅速崛起,大量矩陣運算突然變得非常重要,而GPU平行處理架構剛好與神經網路的需求驚人吻合。

這並非輝達原本預料到的結果,但他們比其他企業更快地捕捉到這波潮流。不但在硬體上持續強化GPU的計算能力,更在軟體端打造CUDA生態系,使研究人員能直接在GPU上進行模型訓練。讓輝達從一間遊戲顯示卡公司,躍升為掌握AI運算核心的科技巨頭。

全球AI頂尖的研究機構與企業,也因為生態系的友善性,被迫進入輝達的世界。久而久之,這形成了一種「科技慣性」:做AI就是用GPU;想做大模型,也必須用GPU。然而,這種「通用型GPU主宰所有AI運算」的格局,也逐漸暴露出限制。尤其當模型越來越大、資料中心的能耗狂飆、AI服務的成本成為企業最大壓力後,業界開始重新審視GPU的本質。這個時刻,也正是Google打造TPU的開端。

在企業普遍擔心AI晶片供應鏈的不確定性、同時又急於降低算力成本的情況下,TPU以其客製化、高能效與完整生態系等特點,成為目前少數真正有能力撼動輝達GPU主導地位的替代選項。

與輝達GPU相比,TPU的適應性較差,但功能更專一,在運行這些操作時功耗也更低。(翻攝自網路)

與輝達GPU相比,TPU的適應性較差,但功能更專一,在運行這些操作時功耗也更低。(翻攝自網路)

TPU處理神經網路時有驚人效率

Google使用AI的歷史遠早於大多數科技公司。他們面臨的挑戰並非如何做出AI,而是如何大規模地把AI部署給全球數十億使用者。無論是YouTube推薦、Gmail垃圾郵件過濾、Google搜尋排序,甚至是語音辨識與自然語言處理,背後都需要大量神經網路推論。

2013年前後,Google開始察覺GPU雖能處理AI訓練,但在雲端推論階段並不完美。功耗、延遲與成本都超出預期,而這對於每天處理數千億次請求的Google來說,是無法承受的負擔。於是,Google下了大膽的決定,打造一個只能做AI的專用晶片,而不是通用運算硬體。

第一代TPU以極高效率處理矩陣乘法,專門為神經網路推論打造。後來Google又推出TPU v2、v3、v4,逐步從推論擴展到訓練,並建立由數百到數千顆TPU組成的TPU Pods,能讓Google在極短時間訓練巨型模型。

與GPU不同,TPU是ASIC(特定應用積體電路),一種越「專用」就越強大的硬體。ASIC的缺點是用途明確、不如GPU彈性;但優點也極為明顯,它沒有多餘的功能,每一個晶片面積、每一個電晶體,都用在AI需要的運算上。

這種思維讓TPU在處理神經網路時展現驚人效率,能一次同時完成大量矩陣運算,而深度學習的本質正是矩陣乘法的堆疊。在這樣的架構下,「TPU不只比GPU在特定AI任務上快得多,也能在相同能耗下完成更多運算」。

GPU被認為具有更高的適應性,但這種靈活性也可能導致其運行成本更高。(資料照,法新社)

GPU被認為具有更高的適應性,但這種靈活性也可能導致其運行成本更高。(資料照,法新社)

TPU功能專一能耗更低

GPU與TPU都是「讓AI跑得更快的晶片」,而TPU是為深度學習客製的專用加速器。深入分析後,兩者在設計哲學上有根本性的差異,而這些差異決定了它們在不同情境下的強弱。

GPU的強項在於「通用性」,就像是一座「多功能大型工廠」。它可以遊戲、可以做物理模擬、可以處理影像、可以跑深度學習,也能用來做各種非AI的平行運算,這讓GPU變得強大而靈活,但也更複雜、更耗電。

TPU則是典型的「單一目的機器」,像是一條「高速自動化生產線」,只做一種零件、效率極高。它不考慮遊戲、不考慮影像、不考慮物理模擬,也不需要處理多樣化演算法,它要做的只有一件事,就是把矩陣乘法(systolic array)做到極致。這種極端聚焦的設計,使TPU能「把更多晶片面積用在真正需要的地方,也讓功耗效率大幅提升。」

《彭博》指出,與輝達GPU相比,TPU的適應性較差,但功能更專一,在運行這些操作時,其功耗也更低。 GPU被認為具有更高的適應性和可程式化,但這種靈活性也可能導致其運行成本更高。

誰想要TPU?《彭博》統計,TPU目前的客戶包括Safe Superintelligence(由OpenAI共同創辦人Ilya Sutskever於去年創立的新創公司)、Salesforce Inc.和Midjourney,以及Anthropic。還有目前Meta Platforms Inc.正在洽談於2027年在其資料中心使用Google TPU。這些進展凸顯了主要的AI公司如何競相採用TPU來增加運算能力,以應對不斷增長的需求。

TPU的出現,代表一種可能性「AI晶片不再只有GPU一種選擇」。(翻攝自網路)

TPU的出現,代表一種可能性「AI晶片不再只有GPU一種選擇」。(翻攝自網路)

AI晶片不再只有GPU一種選擇

然而,TPU想撼動GPU帝國,並不容易。輝達擁有全球最完整的生態系,研究人員、模型開發框架、工具鏈、學術社群通通與其綁定,光是CUDA的壁壘就足以讓許多企業望而卻步。

另外,TPU至今仍屬於Google Cloud內部資源,並不開放給一般企業購買,這限制了它的廣泛普及。也正因如此,TPU雖然技術強悍,但影響力主要仍集中在Google內部與特定合作夥伴。《彭博》指出,目前,想要使用Google TPU的企業必須註冊並租用Google Cloud的運算資源。彭博產業研究分析師表示,Anthropic的合作案可能會使TPU擴展到其他雲端平台的可能性增加。

目前沒有人,包括Google在內,打算完全取代輝達GPU;AI發展的速度意味著這在目前是不太可能的。Gartner分析師Gaurav Gupta表示,Google自身擁有晶片,但仍然是輝達的最大客戶之一,這是為了給客戶維持靈活性。如果客戶的算法或模型發生變化,GPU能更好地處理各種不同的工作負載。輝達發言人表示「輝達在行業中領先一代。我們為Google的成功感到高興,他們在AI上取得了巨大進展,我們也會繼續供應晶片給Google。」

AI的未來或將不再單靠某一家公司推動。當模型規模突破極限,當能耗成為全球科技公司最頭痛的成本問題,當推論量成為新的能源需求,市場終將自然導向更高效率的硬體。TPU的出現,代表一種可能性「AI晶片不再只有GPU一種選擇」。

一手掌握經濟脈動 點我訂閱自由財經Youtube頻道

不用抽 不用搶 現在用APP看新聞 保證天天中獎 點我下載APP 按我看活動辦法